article detail

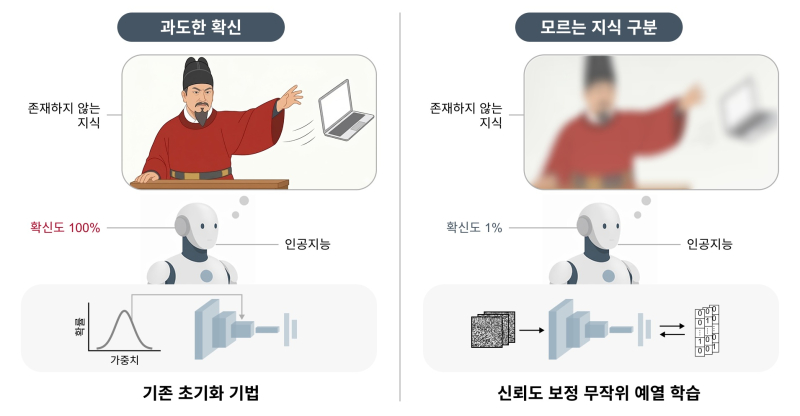

AI, 모르는 것을 "모른다"고 말하게 해야

2026. 4. 29. 오전 9:25

AI 요약

미국 뉴욕의 연방법원 사건을 맡은 변호사들이 지난 2023년 법정에서 AI가 만들어낸 가짜 판례를 제시해 불명예를 안았고, AI가 틀리면서도 높은 확신을 보이는 '과신'은 자율주행차나 의료 분야에서 사고로 이어질 수 있는 문제로 지적됩니다. 이를 해결하기 위해 KAIST의 '무작위 노이즈 예열(Warm-up)', 옥스퍼드의 '의미론적 엔트로피(Semantic Entropy)'를 통한 교차 검증, 구글 딥마인드·토론토대 등이 사용하는 '온도 스케일링(Temperature Scaling)', 베이지안 신경망(BNN), 스탠퍼드대의 '강인한 최적화(DRO)' 등 다섯 가지 접근법이 제안되고 있으며, 전문가들은 이러한 메타 인지 기술이 의료·금융·국방 등 책임이 막중한 분야에서 AI의 신뢰 확보에 필수적이라고 보고 있습니다.