article detail

AI 프롬프트 한 번에 전력 폭증…트랜스포머 이후 차세대 아키텍처 주목

2026. 4. 10. 오후 2:13

AI 요약

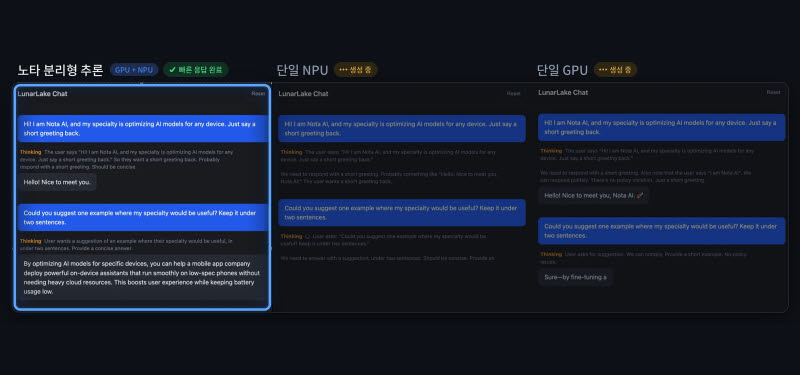

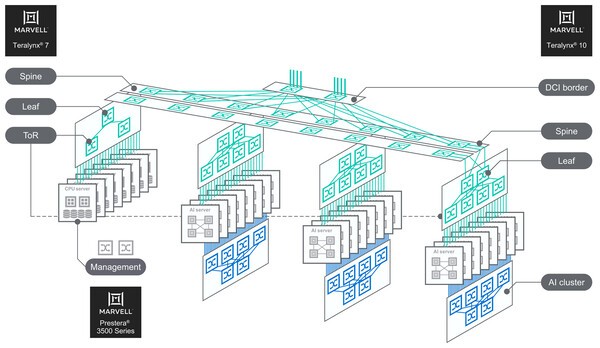

인공지능 확산에 따른 전력 수요 급증은 기존 트랜스포머 기반 대형언어모델(LLM)의 한계를 드러내며 데이터센터 증설만으로는 증가하는 연산 수요를 감당하기 어렵다는 인식이 확산되고 있고, 베인앤드컴퍼니는 데이터센터 관련 연간 지출이 2030년 5000억달러에 이를 것으로 전망했으며 전력망 운영자들은 AI 수요가 에너지 시장 불안 요인이 될 수 있다고 경고하고 특히 추론형 모델은 GPT-4o의 긴 프롬프트가 약 0.42Wh를 소비하는 반면 딥시크-R1은 33Wh 이상, GPT-4.5는 30Wh 수준을 소모한다고 보도되었습니다. 업계는 전력 효율을 높이는 포스트 트랜스포머 구조, 특히 인간의 뇌를 본뜬 드래건 해츨링(BDH) 아키텍처를 대안으로 주목하며 이 구조는 과제와 관련된 인공 뉴런만 선택적으로 활성화하고 시냅스 가소성을 반영해 학습 효율을 높여 전체 모델을 반복 구동하지 않고 필요한 부분만 활용해 추론 비용과 토큰 사용량을 줄이는 데 초점을 맞추고 있습니다. 실제 도입을 위해서는 기존 인프라와의 호환성이 중요하며 업계는 포스트 트랜스포머 구조가 성능과 비용, 호환성을 실제 환경에서 입증할 수 있느냐가 향후 관건이라고 보고 있습니다.

![베라 루빈 시대 준비하는 에이수스… AI 서버 산실 ‘루주 랩’ 가보니[컴퓨텍스 2026]](https://cdn.it.chosun.com/news/thumbnail/202606/2023092163310_444543_511_v150.jpg)

![[혁신기업] 엔비디아·델도 "K-빅테크"… 네이버클라우드, 글로벌AI 도전](https://img1.daumcdn.net/thumb/S1200x630/?fname=https://t1.daumcdn.net/news/202606/04/dt/20260604140117360tybt.png)

![AI의 핵심 ‘열’ 관리… ‘액침냉각 기술’로 데이터센터 전력효율 극대화[‘피지컬 AI 혁명’ 현장을 가다]](https://static.munhwa.com/img/ogImage.jpg)

![스테판 만들 WD 부사장 “AI 거품론은 기우…구조적 성장 국면”[컴퓨텍스 2026]](https://img1.daumcdn.net/thumb/S1200x630/?fname=https://t1.daumcdn.net/news/202606/03/dt/20260603155619004pbbg.jpg)