article detail

메타, ‘토큰화’ 없애고 추론 효율 2배 높인 바이트 언어모델 'BLT' 공개

2026. 5. 12. 오후 6:20

AI 요약

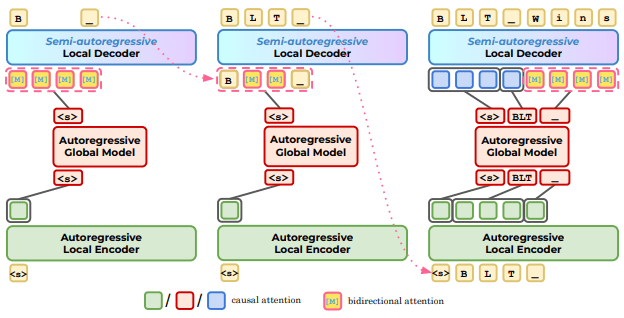

메타와 스탠포드대학교, 워싱턴대학교 공동 연구진은 바이트 단위로 작동하는 언어모델 BLT(Byte Latent Transformer)를 제시했으며, 이 모델은 엔트로피 패칭으로 평균 약 4바이트 크기의 가변 길이 패치로 텍스트를 처리하고 로컬 인코더·글로벌 트랜스포머·로컬 디코더 구조를 갖추고 있습니다. 연구진은 패치 경계와 무관하게 여러 블록을 동시에 복원하는 병렬 디코딩을 포함한 BLT-D, 내부 가벼운 로컬 디코더를 이용해 별도 초안 모델 없이 추측 디코딩을 수행하는 BLT-S, 디퓨전 초안과 자기회귀 검증을 결합한 BLT-DV 등 세 가지 기법을 제안했습니다. 실험에서는 BLT-D-4(3B)가 기존 BLT와 유사한 성능을 유지하면서 메모리 대역폭 사용량을 절반 이하로 줄였고 BLT-D-16은 최대 87~92% 절감, BLT-S는 그리디 디코딩에서 품질 저하 없이 최대 77% 절감, BLT-DV는 최대 81% 절감 효과를 보였으며 BLT-1T(1조 토큰)로 학습한 평가에서 번역에서는 큰 효율 향상을 보였으나 코딩 벤치마크에서는 블록 크기 증가에 따라 성능 민감도가 높아졌습니다.

![[단독] 내년 국가 R&D 예산안, AI가 훑는다…모델은 업스테이지 '솔라'](https://thumb.mt.co.kr/21/2026/05/2026051114384738681_1.jpg?1778564813)