article detail

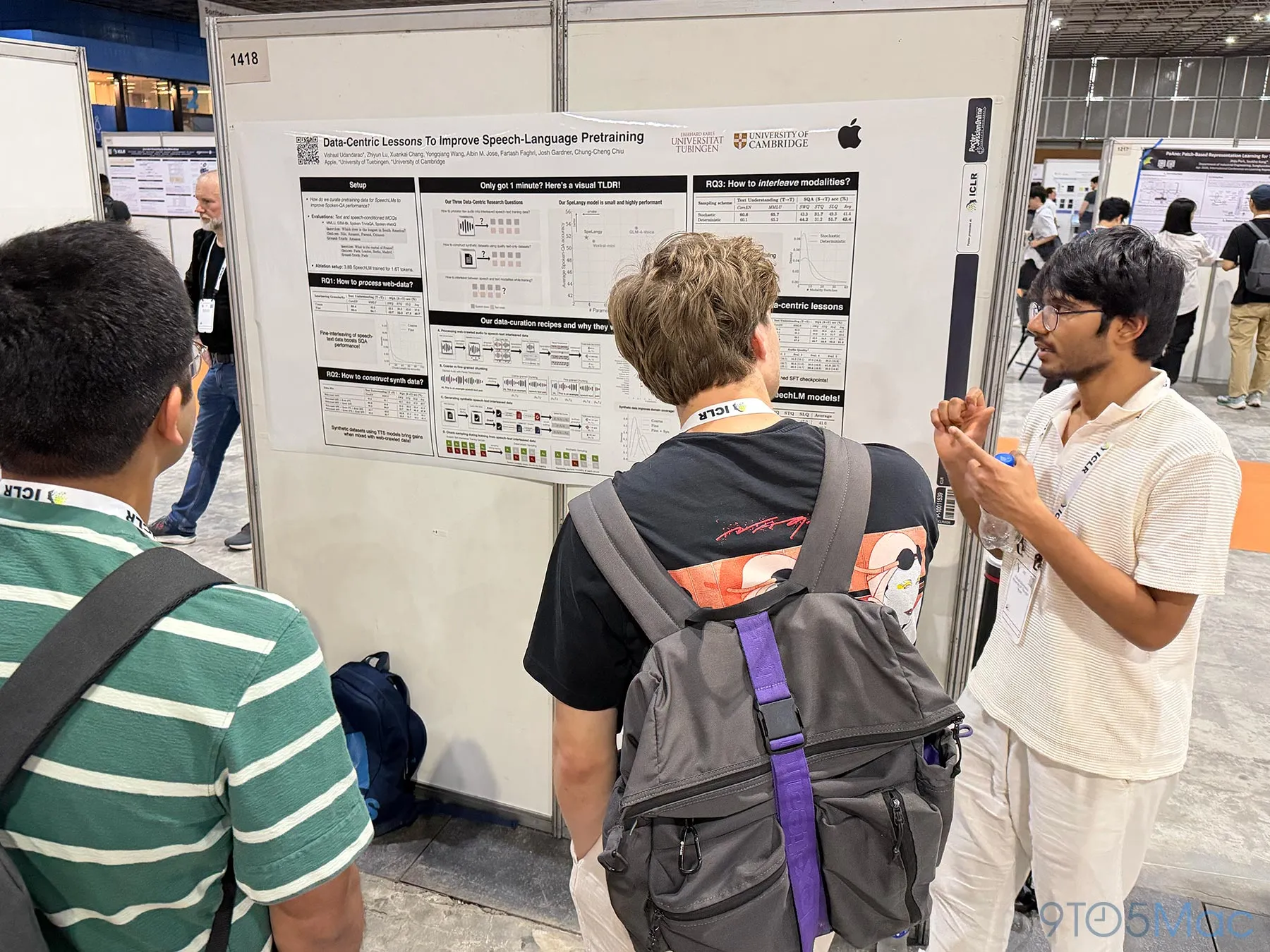

애플, ICLR 2026에서 대규모 RNN 훈련 혁신 발표: AI 효율성 향상 기대

2026. 4. 29. 오후 9:43

AI 요약

애플 연구진은 2026년 4월 제14회 학습 표현 국제 콘퍼런스(ICLR 2026)에서 대규모 순환 신경망(RNN) 훈련을 병렬화하는 ParaRNN을 발표했으며, 논문에 따르면 ParaRNN은 전통적 순차 방식보다 훈련 속도가 665배 빨라 70억 개 매개변수의 고전적 RNN을 훈련해 트랜스포머와 경쟁할 만한 언어 모델링 성능을 달성했다고 밝혔습니다. 애플은 ParaRNN의 핵심 코드베이스를 오픈소스로 공개했고 이 기술이 배터리 제한의 모바일 기기 등 자원 제약 환경에서 대규모 언어 모델을 구현할 가능성을 열었지만 일부 전문가들은 트랜스포머를 완전히 대체할 가능성은 낮다며 신중한 접근을 권고했습니다.

![구글이 문을 열고, 넷플릭스가 사람을 지웠다 [정원훈의 AI 트렌드]](https://cdn.it.chosun.com/news/thumbnail/202604/2023092160143_440638_2342_v150.jpg)