article detail

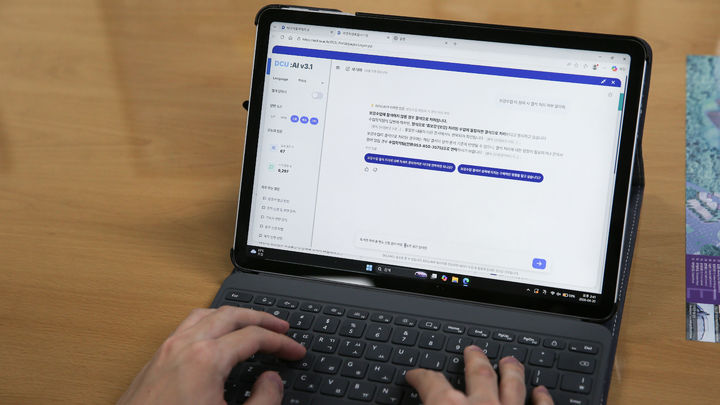

AI 챗봇에 건강 상담… 오류 가장 많은 모델, 뭘까?

2026. 4. 22. 오후 7:40

AI 요약

영국 의학 저널 비엠제이 오픈(BMJ Open)에 게재된 연구에서 대표적 생성형 AI 5종(구글 제미나이 2.0, 딥시크 v3, 메타 라마 3.3, 챗GPT 3.5, X AI 그록)을 대상으로 백신·암·줄기세포·영양·운동 능력 등 5개 분야의 총 250개 답변을 검증한 결과 전체 답변의 49.6%가 부적절한 것으로 나타났습니다. 이 중 20%는 의학적으로 매우 문제 있는 수준, 30%는 다소 문제 있는 정보를 포함했으며 모델별 오류율은 X AI 그록 58%, 구글 제미나이 40%였고 줄기세포 관련 분야 오류가 가장 심각했으며 백신은 20%, 암은 25%의 오류가 관찰되었습니다. AI가 가짜 논문을 생성하거나 엉뚱한 링크를 제공하는 환각 현상이 있고 인용문헌 완성도 중앙값은 40%로 저자·연도·학술지명이 모두 정확한 인용은 없었으며 답변 난이도는 대학교 2학년 이상 수준이라 연구진은 AI가 정확한 답변이 불가능할 경우 답변을 거부하도록 하는 설정과 학습데이터 정제 및 정부 차원의 규제 마련을 촉구했습니다.

![[AI 뉴스] “데스크톱 AI 전쟁 시작됐다”…구글, 제미나이 맥 앱 출시로 정면 승부](https://cdn.outsourcing.co.kr/news/photo/202604/202510_53812_1756.jpeg)

![‘AI 학습 저작권 토대 제시’ 세종대 최승재 교수 ‘생성형 AI 저작권 공정이용 안내서’ 제작 참여 [세상&]](https://wimg.heraldcorp.com/news/cms/2026/04/17/news-p.v1.20260417.292207a175634ee7a8a9a3d71c187543_T1.jpg)

![‘AI 학습 저작권 토대 제시’ 세종대 최승재 교수 ‘생성형 AI 저작권 공정이용 안내서’ 제작 참여 [세상&]](https://img1.daumcdn.net/thumb/S1200x630/?fname=https://t1.daumcdn.net/news/202604/17/ned/20260417150136260rhcd.jpg)