article detail

[기획] 기초상식도 틀리는 AI… 산업 현장에선 '대체품 없어'

2026. 4. 27. 오후 12:00

![[기획] 기초상식도 틀리는 AI… 산업 현장에선 '대체품 없어'](https://cdn.m-i.kr/news/thumbnail/202604/1367929_1154596_655_v150.jpg)

AI 요약

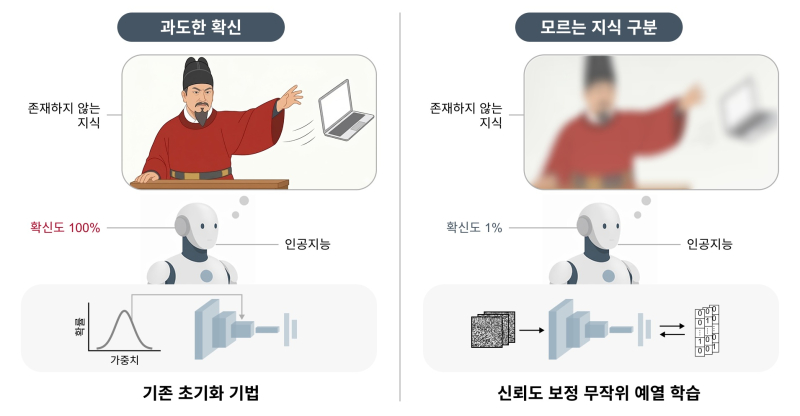

챗GPT, 제미나이 등 생성형 인공지능이 기초 상식 수준의 질문에도 오류를 반복해 기술 신뢰성에 의문이 제기되고 있으며, 예로 챗GPT가 올해 4월 기준 한국 대통령을 묻는 질문에 '윤석열'이라고 잘못 답한 뒤 추가 정보가 주어지자 정정하는 모습을 보였습니다. 그럼에도 산업 현장에서는 비용 절감과 효율성 확보를 이유로 AI 의존도가 높아져 신규 채용 공고가 급감했고, 올해 3월 기준 신입 채용 공고는 791건으로 1년 새 약 45% 줄었으며 교육·출판(-90%), IT·통신(-73%), 판매·유통(-69%), 서비스(-58%) 등에서 큰 감소를 보였습니다. 정부는 '인공지능 발전과 신뢰 기반 조성 등에 관한 법률'을 시행해 생성형 AI 결과물에 AI 생성 표시를 의무화하고 이를 위반하면 최대 3000만원 과태료와 피해 시 손해액의 최대 3배 배상을 부과하도록 했으나 고영향 AI 분류 기준이 모호해 스타트업의 규제 우려와 학계의 윤리 문제(한국연구재단 조사에서 2,079명 중 1,719명(52.8%)이 학계에서 문제가 될 예정이라고 응답)라는 지적이 있습니다.

![[AI를 부탁해 티처스] AI 잘못 썼다간 과태료 3천만 원! ① AI 기본법 바로 알기](https://newsroom.posco.com/kr/wp-content/uploads/2026/04/20260414_img_t_thumb.jpg)

![[콘텐츠 인사이트] AI는 게임 업계 흥행 공식을 바꿀 수 있을까](https://img1.daumcdn.net/thumb/S800x400/?fname=https://t1.daumcdn.net/news/202604/26/bloter/20260426192101905heui.png)

![[김태형의 혁신의기술] 〈51〉AI의 속도, 기술의 '가속'보다 중요한 것은 받아들이는 '자세'(하)](https://img.etnews.com/news/article/2026/04/24/news-p.v1.20260424.7054f9fb9d2646a1b78dffd1e44dba0e_P3.jpg)