article detail

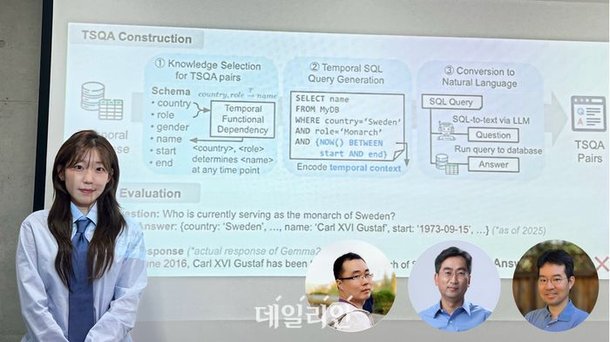

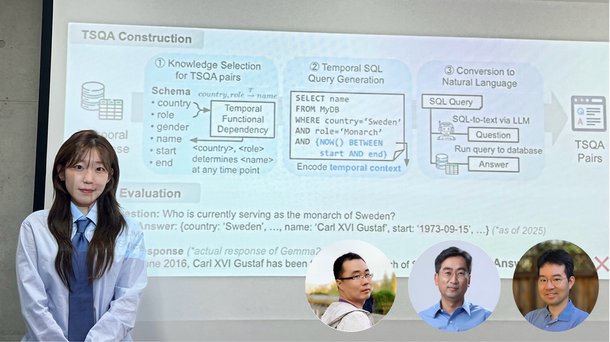

AI에게 AI를 채점하라고 시켰더니 오류는 5% 났지만 실제 점수는 엉망… AI 문서의 ‘정합성’ 문제

2026. 5. 4. 오전 11:49

AI 요약

인도 BITS Pilani의 Manan Gupta와 Dhruv Kumar 연구진이 2026년 4월 공개한 논문 LLM 판사 신뢰도 진단은 챗GPT, LLaMA, Qwen, 미스트랄 등 4개 모델의 평균 위반율이 전체적으로는 0.8%~4.1%로 낮아 보이지만 문서를 30개로 쪼개 평가하자 모델별로 33%~67%의 문서가 적어도 한 차례 추이성 위반을 보였다고 보고했습니다. 특히 미스트랄 스몰(Mistral-Small-3.1)은 한 문서에서 가능한 비교 조합의 30.4%가 순환 모순을 보였고, 사후 정리(MFAS)로 전체 순위를 일관되게 개선하지 못했으며 컨포멀 예측 집합 분석(1,918건)에서는 집합 폭과 실제 판사 오차의 스피어만 상관계수가 +0.576(p<10^-100)으로 문서 자체의 난이도가 모델 간 일치도를 좌우한다는 증거가 제시됐습니다. 연구진은 관련성은 평균 예측 집합 폭 약 3.0으로 자동 평가가 비교적 신뢰할 만하나 일관성 약 3.9, 유창성과 정합성은 평균 폭 4.9로 사실상 불확실하여 사람이 추가 검증해야 한다고 시사했습니다.

![[개발] AI 시간 추론 능력, 자동으로 평가·진단한다](https://elec4.co.kr/media/commonfile/202604/14/f6c4d83c4e8ef0889dcd582ddd8cc401.jpg)

![[테크스냅] 정부 데이터셋, LLM·피지컬AI용으로 재가공](https://news.nateimg.co.kr/orgImg/yt/2026/05/07/PCM20240403000097990_P2.jpg)