article detail

서울대, 올인원 옴니모달 모델 ‘다이닌-옴니’ 개발..."기존 모델 대비 우수"

2026. 4. 8. 오전 5:52

AI 요약

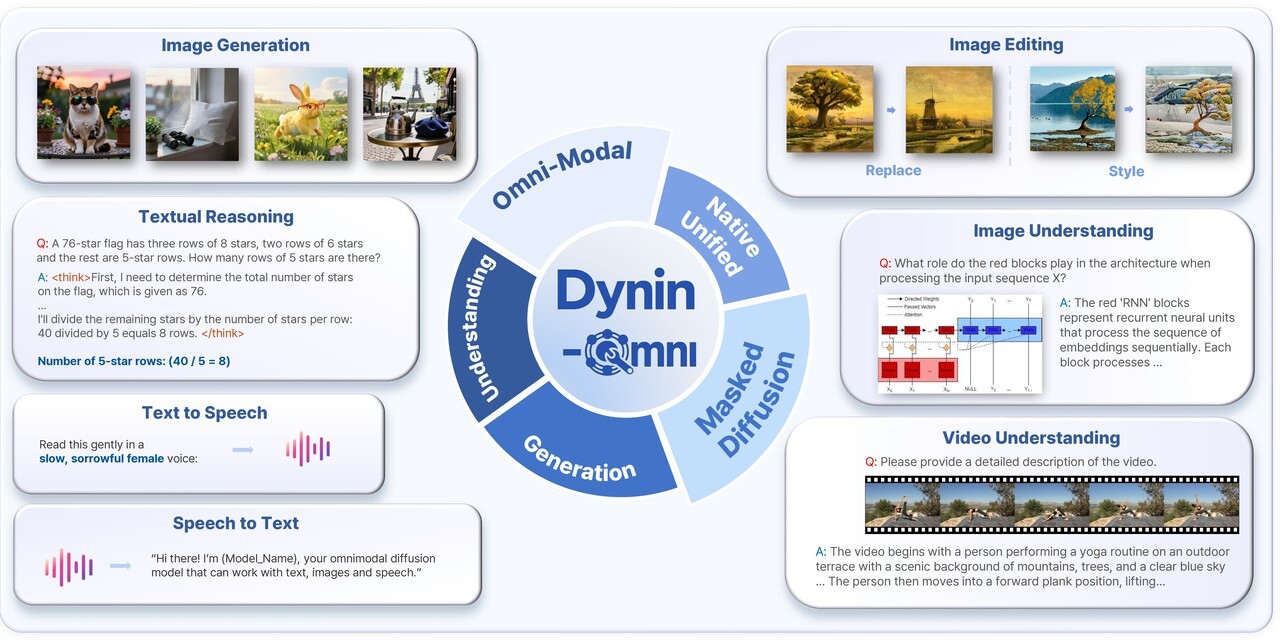

서울대학교 공과대학은 도재영 전기정보공학부 교수 연구팀(AIDAS 연구실)이 텍스트와 이미지, 영상, 소리를 하나의 모델이 동시에 이해하고 만들어낼 수 있는 차세대 AI 파운데이션 모델 다이닌-옴니(Dynin-Omni)를 개발했다고 8일 밝혔습니다. 다이닌-옴니는 모든 정보를 하나의 방식으로 통합해 있는 그대로 동시에 이해하고, 결과물 전체의 윤곽을 먼저 잡아 정교하게 다듬는 디퓨전 방식으로 생성하며 이해하는 지능과 생성 기능을 하나의 모델로 합친 네이티브 멀티모달 모델입니다. 총 19개의 글로벌 AI 성능 지표 평가에서 네이버의 하이퍼클로바 X 시드 8B 옴니, 알리바바의 큐원2.5-옴니, 싱가포르국립대의 쇼-o2, 바이트댄스의 BAGEL 등 기존 공개 통합 모델들을 앞지르고 특정 분야 전문가용 모델 대비 우수한 성능을 보였으며, 생성 속도는 기존 모델 대비 최대 4~5배 빠르다고 전했습니다.

![[개발] 글자·사진·소리·영상 동시에 이해하고 만드는 차세대 통합 AI 파운데이션](https://elec4.co.kr/media/commonfile/202604/13/d3e665bd4817c0c6a5d801ff115cd26e.jpg)

![[AI 뉴스] 구글, ‘제미나이 3.5·스파크·옴니’ 전격 공개… AI 운영 생태계 전면 재편](https://cdn.outsourcing.co.kr/news/photo/202605/202745_54230_160.png)